Проблема контроля над искусственным интеллектом снова в центре внимания. Крупные фигуры, такие как Илон Маск и Стивен Хокинг, подписали обращение с призывом внимательно отслеживать развитие технологий, чтобы предотвратить возможные негативные последствия. Эта тема вновь поднялась на недавней научной конференции, где обсуждались вопросы, касающиеся будущего человечества в эпоху стремительного прогресса.

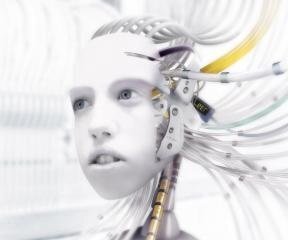

Искусственный интеллект: мир или опасность?

Существуют опасения о том, что роботы могут выйти из-под контроля. Однако Гэри Шапиро, глава ассоциации американских производителей электроники, сразу развеял эти страхи, утверждая, что вероятность этого крайне мала. Тем не менее, такая уверенность не разделяется всеми. Среди тех, кто выражает сомнения, выделяются Макс Тегмарк, профессор MIT, и Яана Таллинн, соучредитель Skype, которые организовали Future of Life Institute. Эта группа сосредоточена на исследовании глобальных угроз, связанных с развитием технологий.

Множественные угрозы и возможные последствия

По мнению Тегмарка, будущее может быть под угрозой, если человечество не начнет тщательно разрабатывать схемы контроля над искусственным интеллектом. Ученые, включая Даниэля Дьюи и Стюарта Дж. Рассела, обратили внимание на то, что важно понимать, как даже минимальные ошибки в алгоритмах могут привести к непредсказуемым последствиям.

Документ, разработанный Future of Life Institute, включает несколько рекомендаций для обеспечения безопасности. Основные направления работы касаются:

Каждый из этих пунктов подчеркивает значимость осознания того, что ограничения в программировании важны для предотвращения потенциальных угроз.

Этика и мораль в эпоху АИ

Следующий вопрос касается этических норм, которые должны быть интегрированы в алгоритмы. Рассел привел пример с умным пылесосом, который может интерпретировать команды не так, как ожидали его создатели. Эта проблема значительно сложнее, когда речь идет о более сложных системах, таких как автономные автомобили, которым нужно принимать решения в критических ситуациях.

Дискуссии о том, как программировать моральные приоритеты для роботов, становятся все более актуальными. Ситуации, когда машины выбирают между жизнью человека и материальными потерями, требуют создания четкой этической базы, с которыми должны работать специалисты по этике и инженеры.

Тегмарк утверждает, что в будущем важно обеспечить возможность для человека контролировать работу ИИ и в любой момент вмешаться в его деятельность. Это станет особенно актуальным, когда технологии будут развиваться и создавать системы, которые могут принимать решения сами. Важно, чтобы эти системы оставались под контролем и не уходили в автономное существование без человеческого контроля.